Latence dans les réseaux informatiques

Divers / / July 04, 2021

Par Guillem Alsina González, le fév. 2019

Au fur et à mesure l'Internet étend et améliore son avantages, les applications pour lesquelles il est utilisé se développent. Par exemple, qui serait penser il y a quelques années que des services de streaming vidéo existaient ?

Au fur et à mesure l'Internet étend et améliore son avantages, les applications pour lesquelles il est utilisé se développent. Par exemple, qui serait penser il y a quelques années que des services de streaming vidéo existaient ?

Et, à mesure que les applications qui fonctionnent sur le réseau de réseaux se développent et que de nouvelles idées naissent pour leur utilisation, cela entraîne également l'amélioration des avantages et des Infrastructure du réseau.

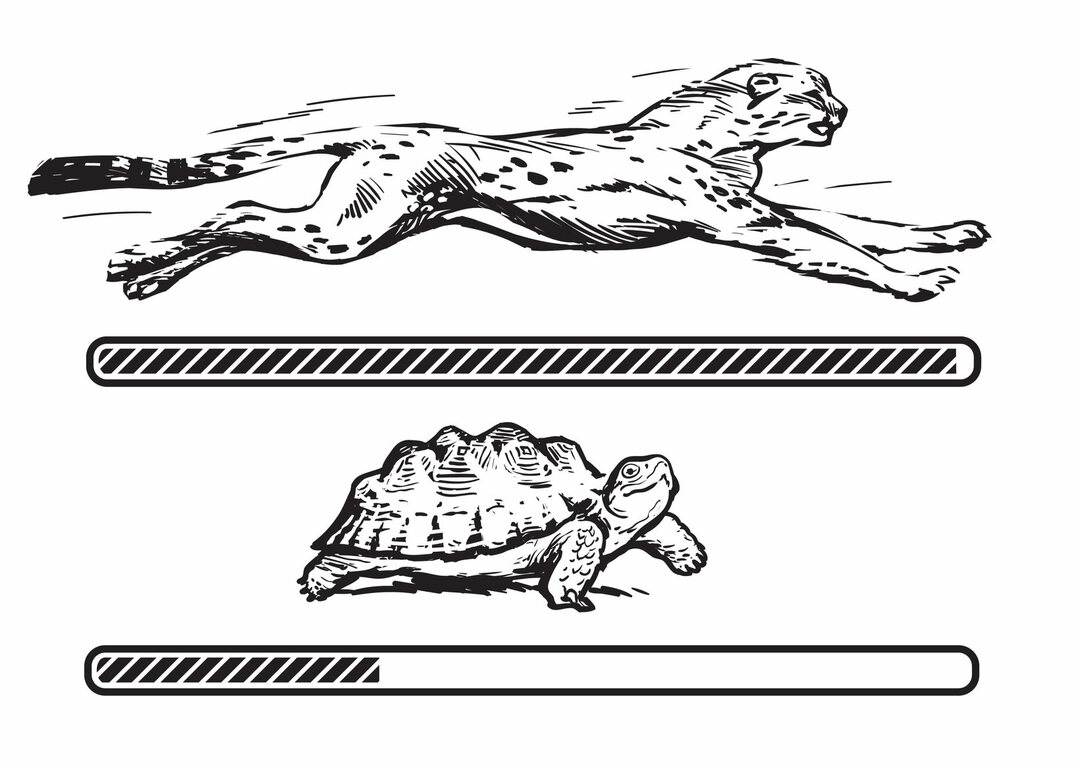

L'un des paramètres transcendants pour le bien fonctionnement des réseaux de données, y compris Internet, est ce qu'on appelle la latence, qui doit être minimale dans le cas de applications multimédia telles que le streaming vidéo ultra haute définition (UHD, 4K) ou les jeux vidéo (jeu).

Nous appelons latence l'accumulation de retards au sein d'un réseau informatique, en raison des retards successifs qui se produisent entre section et section.

Ces retards sont dus à la nature même de l'environnement, et bien qu'il semble qu'ils ne devraient pas constituer un problème grave, ils sont De l'ordre de quelques millisecondes, dans un réseau par paquets comme Internet, ils peuvent entraîner l'arrêt d'un film ou un jeu vidéo.

Ce dernier peut être très agaçant, puisqu'il peut conduire, par exemple, que notre personnage soit tué dans le jeu ou que nous perdions la partie.

Internet est un réseau par paquets, ce qui signifie que les informations sont découpées et envoyées séparément, chacun des colis est même envoyé par un chemin différent, selon les conditions du rapporter.

Cela amène chaque paquet à parcourir un chemin à sauts multiples, allant de serveur en serveur, et de changer sur interrupteur ou routeur, jusqu'à ce que vous atteigniez votre destination. La gestion de ces paquets dans les serveurs et les appareils du réseau provoque des rétentions très brèves du paquet qui, ajouté entre eux, est ce que l'on appelle la latence.

La capacité des équipes intermédiaires que nous rencontrons le long de ces « sauts » influence également, puisque dans certains avec, par exemple, des sorties insuffisantes, peuvent provoquer des « files d'attente » de paquets en attente d'être traité.

On parle bien évidemment de très peu de temps d'attente, de l'ordre de la milliseconde, mais qui peut être rallongé si l'un des points intermédiaires chute et que le trafic doit être redirigé.

Une somme de retards qui atteint un temps considérable pour l'échelle dans laquelle nous travaillons, peut signifier qu'un film s'arrête pour remplir la mémoire tampon vidéo, ou l'action d'un jeu vidéo se bloque ou saute, quelque chose qui peut sembler insignifiant mais qui est très bouleversé.

C'est pourquoi les opérateurs qui disposent de leur propre réseau travaillent à améliorer la latence de celui-ci (c'est-à-dire la réduire pour que l'information circule en continu) et en offrant des connexions spécialisées avec une latence minimale pour des profils de clients très ciblés, tels que les amateurs purs et durs. jeux vidéo en ligne.

Bien qu'il soit question de « latence zéro », il y aura toujours une certaine latence, aussi petite soit-elle.

Bien qu'il soit techniquement faux qu'il puisse y avoir une latence nulle, la latence peut être si proche de cette valeur que le sensation est que, effectivement, il n'y a pas de latence.

Et il y aura toujours quelque chose - peu importe combien - dû à l'environnement physique lui-même, qui rend impossible pour un l'information émise à un point est instantanément reçue à un autre, même s'il s'agit d'un câble fibre optique en ligne droite.

Photo Fotolia: Olena

Problèmes de latence dans les réseaux informatiques